Sommaire

- Comprendre l’optimisation et performance : de quoi parle-t-on vraiment ?

- Un peu d’histoire : des tweaks Windows aux écosystèmes modernes

- Les fondamentaux : mesurer avant d’optimiser

- Les grands piliers d’optimisation et performance (vue d’ensemble)

- Diagnostiquer les goulots d’étranglement : la méthode simple

- Optimiser Windows (ou votre OS) sans le casser

- Stockage, RAM et cache : accélérer sans changer de GPU

- CPU et GPU : fréquences, limites de puissance et stabilité

- Overclocking sécurisé

- Optimisation gaming PC

- Gestion thermique PC

- Logiciels performance système

- Mises à jour pilotes

- Réseau et latence : la performance ne se limite pas aux FPS

- Paramètres BIOS/UEFI : ce qui vaut vraiment le coup

- Énergie, undervolt et profils : gagner en performance utile

- Maintenance et hygiène logicielle : la performance se conserve

- Erreurs fréquentes : ce qui détruit la performance (et la stabilité)

- Plan d’action en 30, 60 et 90 minutes

- Questions fréquemment posées

- Conclusion : construire une performance durable

L’Optimisation et performance n’est pas une obsession de « bidouilleur » : c’est la différence entre un PC qui répond instantanément et une machine qui s’essouffle dès qu’on ouvre trois onglets, lance un jeu ou compile un projet. Bonne nouvelle : gagner en fluidité ne dépend pas uniquement d’acheter du matériel plus cher. Avec la bonne méthode, vous pouvez améliorer la réactivité, réduire la latence, stabiliser les FPS, raccourcir les temps de chargement et prolonger la durée de vie de votre configuration.

Cette page pilier pose les fondations : concepts, priorités, erreurs courantes, mesures fiables et parcours de progression. Vous y trouverez une vision globale pour choisir les bons leviers (système, pilotes, stockage, RAM, CPU/GPU, refroidissement, logiciels) et éviter les « optimisations » qui finissent par casser la stabilité.

Comprendre l’optimisation et performance : de quoi parle-t-on vraiment ?

Quand on dit Optimisation et performance, on mélange souvent plusieurs objectifs : vitesse perçue (ouverture d’apps), performances brutes (FPS, temps de rendu), constance (stabilité des fréquences), et efficacité (performance par watt). Or, chaque objectif implique des réglages différents. Un PC peut afficher un score benchmark élevé mais rester désagréable au quotidien à cause d’un stockage saturé, d’un démarrage encombré ou d’un throttling thermique.

La performance « utile » se mesure par la capacité du système à délivrer le bon niveau de ressources au moment où vous en avez besoin, sans micro-freezes, sans pics de latence, et sans bruit/consommation excessifs. L’optimisation consiste à supprimer les goulots d’étranglement, réduire les tâches parasites, et aligner le matériel, le système et les pilotes sur votre usage (gaming, création, bureautique, dev, IA).

Enfin, une démarche sérieuse d’optimisation et performance s’appuie sur des métriques reproductibles : on change une variable à la fois, on mesure, on valide la stabilité, puis on documente. C’est la méthode la plus simple pour obtenir des gains réels et durables.

Un peu d’histoire : des tweaks Windows aux écosystèmes modernes

Les premières grandes vagues d’optimisation et performance « grand public » ont accompagné l’essor de Windows et des PC grand public : désactivation de services, défragmentation, réglages du registre, puis arrivée des SSD et des pilotes GPU orientés jeu. À l’époque, les systèmes étaient moins autonomes : un mauvais paramètre pouvait plomber la machine pendant des mois.

Aujourd’hui, l’OS gère mieux la mémoire, l’ordonnancement et l’énergie, mais la complexité a augmenté : architecture hybride des CPU, boosting dynamique, gestion fine des états C/P, pilotes multi-couches, overlays, anti-cheat, RGB, capture vidéo, etc. La performance dépend autant du « bruit logiciel » que du matériel.

La conséquence est simple : l’optimisation moderne n’est plus une liste de tweaks universels. C’est un cadre : mesurer, prioriser, sécuriser, automatiser, puis maintenir.

Les fondamentaux : mesurer avant d’optimiser

Sans mesure, l’optimisation et performance devient une croyance. Commencez par capturer un « état de référence » : temps de démarrage, latence en jeu, températures, fréquences, utilisation CPU/GPU, activité disque, et consommation. Pour le gaming, surveillez particulièrement la constance des frametimes : un FPS moyen élevé peut masquer des saccades.

Une approche fiable : (1) définir un scénario (un niveau de jeu, un export vidéo, un compile), (2) répéter trois fois, (3) prendre la médiane. Ensuite, n’appliquez qu’un changement à la fois. Beaucoup de « gains » disparaissent quand on répète les tests avec un protocole identique.

Enfin, distinguez les goulots d’étranglement : CPU-bound, GPU-bound, RAM limitée, IO disque, réseau, ou thermique/énergie. Une optimisation efficace cible d’abord le facteur limitant principal, pas le symptôme.

| Objectif | Indicateurs utiles | Signes typiques | Levier prioritaire |

|---|---|---|---|

| Réactivité au quotidien | Temps d’ouverture, latence UI, usage disque | Démarrage lent, freezes lors de copies | Nettoyage démarrage, SSD/trim, tâches en arrière-plan |

| Gaming fluide | FPS 1% low, frametimes, latence | Micro-saccades, stuttering | Réglages GPU/CPU, VRAM/RAM, pilotes, overlays |

| Création / rendu | Temps d’export, stabilité fréquence | Throttling, ventilateurs à fond | Refroidissement, limites de puissance, pilotes |

| Efficacité énergétique | Perf/W, températures, bruit | Chauffe excessive, autonomie faible | Undervolt, profils d’alimentation, courbes ventilateurs |

Les grands piliers d’optimisation et performance (vue d’ensemble)

Pour structurer votre progression, pensez en piliers. Le premier est le système (démarrage, services, tâches planifiées, intégrité). Le second est la pile logicielle (pilotes, runtime, overlays, antivirus, outils d’optimisation). Le troisième est le matériel (CPU, GPU, RAM, stockage) et sa gestion thermique. Le quatrième est la configuration d’usage : gaming, streaming, création, travail, et leurs compromis.

La plupart des problèmes viennent d’une incohérence entre ces couches : pilote instable, profil d’alimentation mal adapté, mémoire XMP/EXPO non validée, SSD trop plein, ou refroidissement insuffisant pour tenir les fréquences boost. Une stratégie d’optimisation et performance efficace vise la cohérence et la stabilité, puis seulement les gains « records ».

Diagnostiquer les goulots d’étranglement : la méthode simple

Le diagnostic commence par l’observation : en charge, un GPU à 95–99% indique souvent une limitation GPU (normal en jeu), tandis qu’un CPU saturé sur quelques cœurs peut créer du stuttering. Un disque à 100% avec une file d’attente élevée signale un souci d’IO (indexation, swap, antivirus, copie, SSD saturé). Côté RAM, si la mémoire est pleine, le système pagine, et l’expérience se dégrade rapidement.

Ensuite, vérifiez les « limites invisibles » : thermique (températures élevées qui réduisent la fréquence), puissance (PL1/PL2, limites GPU), et VRM/boîtier (airflow). Une optimisation et performance durable cherche d’abord à éliminer ces plafonds.

Enfin, regardez les interactions : un overlay, un logiciel RGB, ou une capture vidéo peut suffire à ajouter de la latence ou des micro-freezes. Dans ce cas, la meilleure optimisation est parfois… la suppression.

Optimiser Windows (ou votre OS) sans le casser

Le cœur de l’optimisation et performance côté système consiste à réduire le bruit de fond sans désactiver au hasard. Commencez par le démarrage : limitez les programmes au lancement, vérifiez les tâches planifiées inutiles, et gardez un antivirus fiable mais raisonnable (les suites trop lourdes coûtent parfois plus qu’elles ne protègent).

Côté stockage, gardez de l’espace libre (surtout sur SSD) pour éviter la baisse de performances en écriture. Vérifiez l’intégrité système, nettoyez les logiciels obsolètes, et évitez les « cleaners » agressifs qui modifient le registre sans bénéfice mesurable.

Enfin, ajustez l’alimentation : sur desktop, un profil axé performance peut réduire certaines latences ; sur laptop, il faut trouver l’équilibre entre chauffe, bruit et autonomie. L’objectif reste le même : une optimisation et performance stable, testable, réversible.

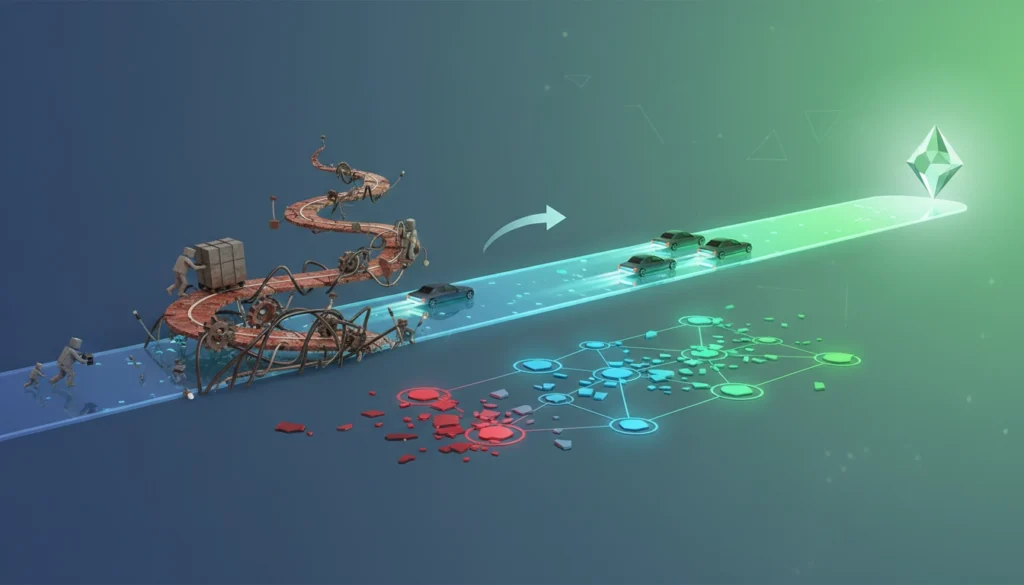

Schéma : la boucle d’amélioration continue en optimisation et performance

Cette boucle vous évite les optimisations « magiques » : vous mesurez, vous ciblez, vous modifiez, puis vous validez. C’est la façon la plus sûre de progresser en optimisation et performance tout en gardant un système fiable.

Stockage, RAM et cache : accélérer sans changer de GPU

Beaucoup de gains d’optimisation et performance viennent du trio stockage–RAM–cache. Un SSD rapide n’aide pas si le disque est quasi plein, si le firmware est obsolète, ou si des tâches (indexation, antivirus) saturent l’IO pendant vos sessions. Gardez une marge d’espace libre, et évitez d’installer tout votre catalogue de jeux sur le même volume saturé.

La RAM, elle, agit sur la fluidité : fréquence, timings et capacité. Trop peu de RAM déclenche le swap ; une RAM instable crée des erreurs silencieuses ou des crashs. La règle : activer XMP/EXPO si votre configuration le supporte, puis tester la stabilité avant de considérer l’optimisation comme « validée ».

Enfin, les caches (shader cache, caches navigateurs, caches applicatifs) améliorent les temps de chargement. Mais des caches corrompus peuvent causer stuttering ou artefacts : savoir les purger au bon moment fait partie d’une optimisation et performance pragmatique.

CPU et GPU : fréquences, limites de puissance et stabilité

Les performances modernes dépendent largement des algorithmes de boost : ils montent en fréquence tant que la température, la tension et la puissance restent dans les limites. Résultat : la performance n’est pas un chiffre fixe, mais une « enveloppe » qui varie selon le refroidissement, le boîtier, la pâte thermique, la courbe ventilateurs et le profil d’alimentation.

Deux leviers sont souvent plus efficaces qu’un overclocking agressif : (1) optimiser les limites de puissance pour maintenir des fréquences stables, (2) undervolt/curve optimizer pour réduire la chauffe à performance équivalente. Dans une démarche d’optimisation et performance, la stabilité et la constance priment : un gain de 3% qui ajoute des crashs n’est pas un gain.

Pensez aussi à l’équilibre : un GPU haut de gamme peut être bridé par un CPU ou une RAM mal configurée, tandis qu’un CPU puissant peut être inutile si la carte graphique est le goulot permanent. L’objectif est d’aligner les composants sur votre résolution, votre écran (VRR), et vos usages.

Overclocking sécurisé

L’overclocking peut offrir un supplément de performance, mais il n’a de valeur que s’il est prévisible. Un overclocking « sécurisé » s’appuie sur des tests progressifs, des températures maîtrisées et des limites de tension raisonnables. Le but n’est pas d’atteindre un record, mais de gagner en optimisation et performance tout en conservant une marge de stabilité sur la durée.

La méthode la plus saine consiste à partir d’un profil stable, puis à ajuster par petits incréments (fréquence, tension, courbe), en validant à chaque étape. Il faut aussi distinguer CPU et GPU : les crashs ne se manifestent pas toujours de la même façon, et les benchmarks courts peuvent masquer des instabilités longues.

Pour une démarche guidée et structurée, vous pouvez apprendre l’overclocking CPU et GPU en toute sécurité afin de comprendre les limites, les tests, et les réglages qui maximisent la performance sans sacrifier la fiabilité.

Optimisation gaming PC

En jeu, l’optimisation et performance se résume rarement à « tout mettre en ultra ». L’objectif est une expérience fluide : FPS stables, frametimes réguliers, latence réduite, et un système qui ne sature pas en arrière-plan. La résolution, le DLSS/FSR/XeSS, la synchronisation (G-Sync/FreeSync), et certains réglages (ombres, distance d’affichage, RT) ont un impact disproportionné sur la fluidité.

Le vrai levier est l’équilibre : ajuster les options pour améliorer les 1% low, limiter le stuttering (shader compilation, streaming de textures), et contrôler ce qui tourne en même temps (capture, overlays, navigateur, launchers). Selon les jeux, un simple ajustement du mode plein écran, du cache shaders ou de la limite d’images peut transformer la sensation.

Pour aller plus loin, vous pouvez optimiser vos jeux PC pour gagner des FPS stables avec une approche par scénarios (e-sport, AAA, VR, streaming) et des réglages concrets orientés résultats.

Gestion thermique PC

La température est l’un des ennemis les plus sous-estimés de l’optimisation et performance. Un CPU ou un GPU trop chaud réduit ses fréquences (throttling), ce qui crée des chutes de FPS, des exports plus longs et un bruit excessif. La gestion thermique est donc un « multiplicateur » : elle stabilise la performance, améliore l’efficacité énergétique et protège les composants.

Les gains viennent souvent d’actions simples : nettoyer les filtres, améliorer l’airflow, repositionner des ventilateurs, ajuster les courbes, remplacer une pâte thermique vieillissante, ou réduire légèrement la tension. Ce sont des optimisations mesurables, avec un excellent rapport effort/résultat.

Si vous voulez une approche complète (airflow, AIO vs aircooling, courbes, diagnostics), vous pouvez améliorer le refroidissement et la gestion thermique de votre PC pour gagner en constance, en silence et en longévité.

| Symptôme | Cause probable | Vérification | Action d’optimisation |

|---|---|---|---|

| Chutes de fréquence en charge | Throttling thermique ou limite de puissance | Températures + logs fréquences | Airflow, courbe ventilateurs, limites PL, undervolt |

| Stuttering en jeu | Shader compilation, VRAM/RAM, tâches en fond | Frametimes, VRAM, activité disque | Pilotes, cache shaders, réglages textures, fermer overlays |

| PC « lent » au quotidien | Démarrage encombré, SSD saturé | Gestionnaire de tâches + espace disque | Désactiver au démarrage, libérer espace, vérifier santé SSD |

| Crashs aléatoires | OC instable, RAM, pilote | Tests long + journaux événements | Réduire OC, valider XMP/EXPO, réinstaller pilote propre |

Logiciels performance système

Les « optimiseurs » miracles sont rarement utiles, mais les bons logiciels de performance système sont indispensables pour mesurer, diagnostiquer et automatiser. Une optimisation et performance sérieuse repose sur des outils qui affichent les métriques (températures, fréquences, frametimes), et qui permettent de contrôler proprement les paramètres (ventilateurs, profils, limites de puissance).

L’idée n’est pas d’empiler des programmes : plus vous ajoutez de services, plus vous créez de risques de conflit et de latence. Privilégiez un petit ensemble cohérent : monitoring fiable, réglages matériel, et éventuellement un outil de nettoyage ciblé (désinstallation propre, gestion du démarrage), plutôt qu’un « booster » opaque.

Pour choisir et configurer les bons outils (selon gaming, création, ou usage mixte), vous pouvez découvrir les meilleurs logiciels d’optimisation PC et apprendre à les utiliser sans alourdir votre système.

Mises à jour pilotes

Les pilotes sont un pilier majeur de l’optimisation et performance : ils impactent la compatibilité, la stabilité, la latence et les performances en jeu. Mais « tout mettre à jour » n’est pas une stratégie. Il faut savoir quoi mettre à jour, quand, et comment revenir en arrière si une version introduit un bug (stuttering, crash, baisse de FPS, soucis VR).

Pour le GPU, les versions peuvent intégrer des optimisations spécifiques à des jeux récents. Pour le chipset, le réseau, l’audio et le stockage, les mises à jour corrigent souvent des comportements subtils (latences DPC, gestion d’énergie, stabilité). Le point clé : documenter la version, tester sur votre scénario, et conserver un plan de rollback.

Si vous voulez une procédure claire et sûre, vous pouvez mettre à jour vos pilotes correctement afin d’améliorer la stabilité et la performance sans vous exposer à des installations hasardeuses.

Réseau et latence : la performance ne se limite pas aux FPS

Dans beaucoup de jeux compétitifs, la latence réseau et la stabilité de la connexion comptent autant que la puissance brute. Une optimisation et performance orientée e-sport s’intéresse aux pics de ping, à la perte de paquets, au Wi-Fi saturé, et aux processus qui monopolisent la bande passante (sync cloud, mises à jour en arrière-plan, streaming).

Sur PC, la latence peut aussi venir du système : pilotes réseau, paramètres d’économie d’énergie, et parfois un excès d’outils « gaming network » qui ajoutent des couches inutiles. La règle : garder une configuration simple, mesurer avant/après, et privilégier l’Ethernet si possible.

Enfin, ne négligez pas l’environnement : routeur, canal Wi‑Fi, qualité du câble, et congestion aux heures de pointe. Optimiser la latence, c’est souvent supprimer une cause évidente plutôt que chercher un tweak complexe.

Paramètres BIOS/UEFI : ce qui vaut vraiment le coup

Le BIOS/UEFI peut transformer la stabilité et donc l’optimisation et performance, mais seulement si vous savez ce que vous faites. Les réglages les plus utiles pour la majorité des utilisateurs : activer XMP/EXPO (puis tester), vérifier que le mode PCIe est correct, mettre à jour l’UEFI si une version corrige des problèmes (compatibilité RAM, stabilité), et activer les options pertinentes pour votre plateforme (par exemple le redimensionnement BAR si applicable).

Évitez en revanche les modifications « à l’aveugle » sur des tensions avancées. Une instabilité légère peut se manifester sous forme de crash aléatoire, corruption de fichiers ou performances incohérentes. Dans une logique d’optimisation et performance, le BIOS doit apporter de la constance, pas de l’incertitude.

Si vous changez plusieurs paramètres, notez-les. La documentation est une arme : elle vous permet de revenir à une base stable sans perdre des heures.

Énergie, undervolt et profils : gagner en performance utile

On associe souvent performance à « plus de watts ». Pourtant, un undervolt bien fait peut améliorer l’optimisation et performance en réduisant la chauffe, ce qui maintient des fréquences plus hautes plus longtemps. Sur GPU, une courbe tension/fréquence optimisée donne souvent une expérience plus stable (moins de throttling) qu’un overclocking brut.

Côté CPU, selon la plateforme, des réglages de courbe/offset peuvent réduire les températures et le bruit. L’enjeu : tester la stabilité (charges longues, jeux, rendu) et surveiller les erreurs. La performance n’est pas uniquement un pic ; c’est une moyenne stable sur votre usage réel.

Enfin, pensez « profils » : un profil silence pour le quotidien, un profil performance pour le jeu, et un profil efficacité pour les longues sessions. Une optimisation et performance mature sait s’adapter au contexte.

Maintenance et hygiène logicielle : la performance se conserve

La dégradation de performance au fil du temps est souvent liée à l’accumulation : applications au démarrage, services inutiles, drivers installés en cascade, restes de logiciels, caches, et disques saturés. Une stratégie d’optimisation et performance inclut une routine : vérifier l’espace libre, contrôler les mises à jour importantes, auditer le démarrage, et garder un système propre.

La sécurité fait partie de la performance : un système infecté ou encombré par de l’adware devient instable et lent. Gardez des sauvegardes, un point de restauration (ou une image système) et un plan simple pour revenir à une configuration saine.

Enfin, mettez en place des repères : si vos températures ont pris +10°C en un an, ou si les frametimes se dégradent après une mise à jour, vous aurez immédiatement une piste. L’optimisation et performance, c’est aussi savoir détecter quand « quelque chose a changé ».

| Fréquence | Action | Pourquoi c’est utile | Impact typique |

|---|---|---|---|

| Chaque semaine | Vérifier l’espace disque et le démarrage | Évite la saturation IO et les lenteurs au boot | Réactivité plus constante |

| Chaque mois | Contrôler températures et poussière | Réduit le risque de throttling | FPS/performances plus stables |

| À chaque mise à jour pilote | Tester un scénario reproductible | Valide les gains et détecte les régressions | Moins de surprises |

| Trimestriel | Audit logiciels et services inutiles | Réduit le bruit de fond | Latence plus faible |

Erreurs fréquentes : ce qui détruit la performance (et la stabilité)

La première erreur est de changer trop de choses à la fois : impossible ensuite d’identifier la cause d’un gain ou d’un problème. La deuxième est de confondre benchmark court et usage réel. La troisième, très courante, est de suivre des listes de tweaks génériques qui désactivent des services au hasard : vous gagnez parfois 0,5% et vous perdez des fonctions, de la stabilité, ou de la sécurité.

Autre piège : empiler des outils (RGB, monitoring, overlays, « boosters ») qui se battent pour les mêmes ressources. Un PC performant est souvent un PC sobre. Enfin, l’overclocking agressif sans validation longue est une source majeure de crashs, de corruption et de performances incohérentes.

La bonne boussole : si une modification n’est pas mesurable, réversible et utile à votre scénario, elle n’est probablement pas une optimisation et performance pertinente.

Plan d’action en 30, 60 et 90 minutes

En 30 minutes : nettoyez le démarrage, libérez de l’espace disque, mettez à jour l’OS, et vérifiez les températures en charge. En 60 minutes : vérifiez les pilotes clés (GPU, chipset), ajustez le profil d’alimentation, désactivez overlays inutiles, et lancez un test reproductible (jeu/rendu) avant/après.

En 90 minutes : validez XMP/EXPO, mettez en place une courbe ventilateurs plus intelligente, et documentez votre configuration (versions pilotes, paramètres majeurs). Si vous voulez aller plus loin, envisagez un undervolt modéré, puis re-testez.

Ce plan vise le maximum de gains « réels » d’optimisation et performance sans entrer immédiatement dans les réglages risqués. La progression vient de la répétition : mesurer, améliorer, stabiliser.

Questions fréquemment posées

Quelle est la première étape pour améliorer l’optimisation et performance d’un PC ?

Mesurer un état de référence (FPS/frametimes, températures, usage CPU/GPU/disque) puis identifier le principal goulot d’étranglement avant de modifier quoi que ce soit.

Faut-il désactiver des services Windows pour gagner en performance ?

Rarement de façon utile. Il vaut mieux réduire les programmes au démarrage, supprimer les logiciels inutiles et éviter les tweaks agressifs qui dégradent la stabilité ou la sécurité.

XMP/EXPO augmente-t-il vraiment les performances ?

Oui, surtout sur certains jeux et charges CPU. Mais il faut tester la stabilité : une RAM instable peut provoquer crashs, erreurs et performances irrégulières.

Undervolt ou overclocking : que choisir pour un PC stable ?

Pour la majorité des usages, un undervolt bien validé améliore souvent la constance (moins de chauffe, moins de throttling). L’overclocking peut apporter un gain, mais demande plus de tests et de prudence.

À quelle fréquence mettre à jour les pilotes GPU et chipset ?

Mettez à jour quand vous avez un besoin (nouveau jeu, correctif, bug) ou quand une version apporte une amélioration mesurable. Testez après mise à jour et gardez un plan de retour en arrière.

Conclusion : construire une performance durable

L’Optimisation et performance n’est pas une série de trucs secrets : c’est une discipline simple, basée sur la mesure, la priorité au goulot d’étranglement et la validation de la stabilité. En structurant vos actions (système, pilotes, matériel, thermique, usage), vous obtenez une machine plus rapide, plus fluide et plus fiable.

Le plus important : cherchez la constance. Un PC qui tient ses fréquences, garde de bonnes températures et reste propre côté logiciel offrira toujours une meilleure expérience qu’une configuration « poussée » au-delà du raisonnable. Revenez à cette page comme à une carte : choisissez un pilier, appliquez un changement, mesurez, et avancez.